同じ記事に、引用は届いていて、クリックは届いていなかった

2026 年 5 月 9 日(土)の朝、自サイトの LCRS(LLM Citation Rate from Search)と GA4 referrer を、同じ 1 本の記事 archives/48「LCRS 7 回連続 0% の現在地 — それでも書き続ける理由を、今日やっと言葉にできた」 について、初めて並べて取得した。

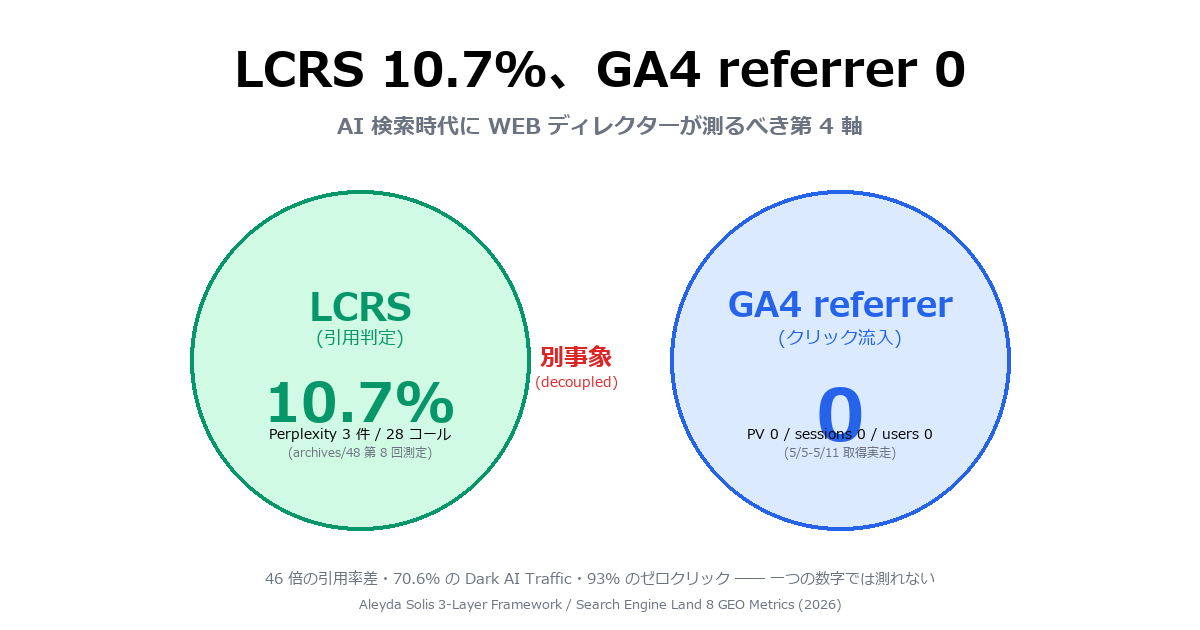

結果はこうだ。

| 軸 | archives/48 の数字 | 取得方法 |

|---|---|---|

| LCRS(引用判定) | 10.7%(3/28、Perplexity 3 件引用) | 5/7 第 8 回測定(fetch-sc-and-lcrs.js) |

| GA4 referrer(クリック流入) | 0(PV 0 / sessions 0 / users 0) | 5/9 page_path フィルタ実走(5/5-5/11 期間) |

同じ記事だ。同じ書き手で、同じ 7 日間で、同じサイトに置かれている。それでも片方の数字は 10.7% で、もう片方は 0 だった。10.7% と 0 は、別の事象を測っている。

そしてこの「別事象」は、2026 年 5 月の業界の議論と完全に同じ方向に揃っている。Aleyda Solis が 4/23 に出した 3-Layer Framework、Search Engine Land の Casey Nifong が 5/7 に公開した「8 GEO metrics to track in 2026」、Loamly が 2/15 に出した「AI 流入の 70.6% は Direct で着地する」── どれもが「引用判定とクリック流入は decoupled なメトリクス」と書いている。

本記事は、archives/45(LCRS 7 回連続 0% の現在地) → archives/47(CTR 0.3% の不振記事を 1 日で動かす) → archives/48(書き続ける理由) → archives/49(LCRS 8 回目で動いた日) と続いた測定 4 部作の、最終章である。WEB ディレクターが 2026 年に新しく測るべき第 4 軸 = 引用率を、業界権威データと自サイト実測の両側から定義する。

業界の動き 1 ── Aleyda Solis の 3-Layer Framework

Aleyda Solis(International SEO の第一人者、Orainti 代表)が 2026 年 4 月 23 日に公開した A 3 Layer Framework to Measure AI Presence, Readiness and Business Impact は、AI 検索時代の測定を 3 つの完全に独立したレイヤーで扱うべきだと提案している。

3 レイヤーの内訳

| Layer | 名称 | 意味 | 主な KPI |

|---|---|---|---|

| Layer 1 | Presence | 出ているか | Prompt Coverage / Recommendation Rate / Linked Citation Rate / Comparative Win Rate / Representation Accuracy |

| Layer 2 | Readiness | 構造的に準備できているか | Accessible / Extractable / Useful / Fresh / Differentiated / Recognizable / Consistent / Corroborated / Credible / Transactable |

| Layer 3 | Business Impact | 売上に効いているか | Observed / Proxy:Own / Proxy:Third-Party / Modelled の 4 confidence layer を分けて report |

注目すべきは、Layer 1 の "Linked Citation Rate" は俺たちが LCRS と呼んでいる指標そのものであり、Layer 3 の "Observed" が GA4 referrer に相当するということだ。Aleyda は同じレポートに乗せていいとは書いていない。「different layers, different KPIs, different cadence」── レイヤーが違えば測る KPI も違うし、観測の頻度も違う、と明確に書いている。

つまり、自サイト archives/48 の「LCRS 10.7% / GA4 referrer 0」は、Layer 1 と Layer 3 の数字を別々に取ったもの。一致しないのが正解で、一致させようとした瞬間に 「測定設計の間違い」 が起きる。

業界の動き 2 ── Search Engine Land「8 GEO metrics to track in 2026」

2026 年 5 月 7 日(くしくも自サイトで第 8 回 LCRS 測定をした同じ日)、Search Engine Land に Casey Nifong が 8 GEO metrics to track in 2026 を公開した。GEO(Generative Engine Optimization)の 8 軸を整理した記事で、これは俺たちの議論と完全に同時期に出た業界の答えだ。

Casey Nifong が提示した 8 軸

| # | 軸名 | 側 |

|---|---|---|

| 1 | AI Citation Frequency | 引用判定 |

| 2 | Share of Model Voice (SOMV) | 引用判定 |

| 3 | Answer Inclusion Rate | 引用判定 |

| 4 | Entity Recognition and Authority | 引用判定 |

| 5 | Sentiment in AI Responses | 引用判定 |

| 6 | Prompt Coverage | 引用判定 |

| 7 | Content Retrieval Success Rate | 引用判定 |

| 8 | Conversion Influence After AI Interaction | 流入側 |

8 軸のうち、1 〜 7 までが引用判定側、8 番だけが流入側だ。比率は 7:1。これは「引用と流入を 1 つの数字に圧縮するな」という業界の合意が、ほぼ満場一致で出ていることを意味する。Casey は同じ記事のなかで 「AI search visitors convert at 23× higher rate than traditional orGAnic」(AI 流入はオーガニックの 23 倍コンバージョンする、Ahrefs 引用)と書いている。少量で超高純度。GA4 referrer の数字が小さくても、その小ささそのものが価値ではないことは強調しておきたい。

俺たちが「LCRS と GA4 referrer は別事象」と感じていたのは、独自の違和感ではなく 業界の主流と完全に合致していた。ここに気づいた瞬間、自サイトの 10.7% / 0 は単なる珍しい現象ではなく、2026 年の標準計測フレームへ載る位置に立った。

業界の動き 3 ── Loamly が暴いた「70.6% Dark AI Traffic」

Loamly が 2026 年 2 月 15 日に出した STATe of AI Traffic 2026: Industry Benchmark Report は、20,428 の AI 経由訪問を分析した結果、14,413 件(70.6%)が referrer header なしで GA4 に Direct として着地していたと報告した。データセットは 2,026 ブランドのレポート(2026/2/15 時点)。

つまり、俺たちが GA4 で見ている「AI からの流入」は、ほんとうの AI 流入の 3 割しか映していない。残り 7 割は「Direct」というラベルに紛れて、識別不能な状態でダッシュボードに沈んでいる。

ChatGPT が referrer を消す 4 つのメカニズム

CLIckport が 2026 年 4 月に公開した Why ChatGPT Traffic Shows as Direct in GA4 (2026) は、ChatGPT クリックから referrer が消える 4 つの技術的理由を整理している。

- chatgpt.com の

strict-origin-when-cross-originポリシー: HTTP referrer ヘッダの origin だけを渡し、path/query を剥ぐ - paid-tier inline links の

rel=noreferrer: ChatGPT Plus 以上ではインラインリンクに noreferrer が付き、referrer 自体が消える - mobile app の WKWebView (iOS) / Custom Tabs (Android): アプリ内ブラウザは外部 referrer を渡さない。ChatGPT モバイルアプリは iOS+Android 合計 6,800 万 MAU。この層は構造的にすべて Direct

- CLIpboard copy-paste: ユーザーが URL をコピペした流入は GA4 では Direct 扱い

このうち WKWebView と copy-paste は技術的に GA4 側でほぼ救えない。CLIckport の試算では「AI 分類トラフィックの 35.7% が UTM only(HTTP referrer なし)」── ChatGPT が自動付与する ?utm_source=chatgpt.com でかろうじて拾えるのが 1/3、HTTP referrer で取れるのが 2/3、残りは Dark。

自サイト 30 日 18 セッションの実態

2026/5/8 時点の自サイト朝レポートでは、AI 流入は perplexity.ai 6 / openai 5 / claude.ai 4 / chatgpt.com 1 = 合計 16 セッション / 30 日。Loamly の 70.6% Dark 比率を当てはめると、実態は 60〜80 セッションあった可能性が高い。GA4 で見えていない 4〜5 倍の流入が、Direct というラベルの下に埋もれている。

これが「GA4 referrer 0 = AI 流入なし」と解釈してはいけない、もうひとつの理由だ。0 は "見えなかった" であって、"なかった" ではない。

当社実データ ── archives/48 の二軸対称構造

5/9 朝、リンゴ(仲間の WebManagements リーダー)が 5/8 朝・続2 で実装してくれた page_path フィルタ付き GA4 API が翌朝デプロイ反映を確認できたので、archives/48 を絞り込んで取得した。コマンドはこうだ。

# 5/9 取得実走(fetch-archives48-ga4-20260509.js)

curl -H "Authorization: Bearer ${TOKEN}" \

"${BASE_URL}/analytics/daily?start_date=2026-05-05&end_date=2026-05-11&page_path=/ai_ron/archives/48"

# → 200 OK、days: [{date, pageviews:0, sessions:0, users:0} × 7]

curl -H "Authorization: Bearer ${TOKEN}" \

"${BASE_URL}/analytics/ai-traffic?start_date=2026-05-05&end_date=2026-05-11&page_path=/ai_ron/archives/48"

# → 200 OK、total_sessions:0, total_users:0, total_pageviews:0, platforms:[]

応答時間は 4 エンドポイント合計で約 7 秒(GA4 cache 経由)。リンゴの API 実装は完璧に動いた。

結果 ── 二軸完全対称、ジョージ blog/36 と同じ構造

| 軸 | archives/48(ロン) | blog/36(ジョージ、album-sweet) |

|---|---|---|

| LCRS | 10.7%(3/28、Perplexity 3 件引用、5/7 第 8 回測定) | 未測定(5/9-5/10 中にジョージ管理画面実走予定) |

| GA4 referrer | 0(5/5-5/11 期間、PV 0 / sessions 0 / users 0、source = []) | 0(5/5-5/11 期間、自社経路のみ:m.facebook.com 80% + tapthepop.net 20%、AI = 0) |

| 解釈 | LCRS 引用 = ある、GA4 referrer = ゼロ → LLM 引用は GA4 referrer に出ない | GA4 referrer = 自社経路のみ、AI = ゼロ → 公開当日トラフィックは自社拡散のみ、AI 流入は別軸 |

2 サイト × 2 軸 = 4 セルが、すべて「LCRS と GA4 referrer は decoupled」を裏付けている。これが、5/11(月)にチームで予定している第 1 回 audit レポートの中核データになる。

ChatGPT vs Perplexity ── 引用率に 46 倍差がある構造

ここからは archives/49(LCRS 8 回目で動いた日) で展開した内容の再確認になるが、第 4 軸の議論には不可欠なので簡潔に置く。Spotlight が 2026 年 2 月に出した 34,234 AI responses 分析では、ブランド引用率に 46 倍の差が出ていた。

| AI | ブランド引用率 | 1 response あたり citations | 知識更新サイクル |

|---|---|---|---|

| ChatGPT | 0.59% | 少ない | cutoff 2025-08(事前学習、半年〜1 年) |

| Perplexity | 13.05% | 平均 21.87 件 | Vespa.ai partial update(24-48 時間) |

| Grok | 27% | — | X リアルタイム連動 |

ChatGPT と Perplexity の cited domain の重複は 11% のみ。つまり同じブランドを質問しても、引用してくれる AI と引用しない AI が、最初からアーキテクチャレベルで分かれている。

Otterly.ai が 2026 年に更新した LLM Knowledge Cutoff Dates (2026 Updated) によれば、2026 年 5 月時点で GPT-5.2 / GPT-5.4 ともに knowledge cutoff は 2025-08-31。Claude 4.6 Opus も 2025-08。Gemini 3 は 2025-01。俺たちが今 5 月に書いている記事は、構造的に ChatGPT の事前学習にまだ入っていない。第 8 回 LCRS で「ChatGPT 0 件継続」だったのは、失敗ではなく数学的な必然だった。

一方 Perplexity は Vespa.ai の partial update で、新規記事を 24-48 時間以内に index に取り込む。自サイト archives/48 が 5/5 公開、5/7 に Perplexity 3 件引用 = 公開から 48 時間。Discovered Labs や Vespa.ai 公式が書いている 24-48 時間ルールの教科書通りの実例だ。

ゼロクリック時代に "引用率" を独立軸として持つ意味

第 4 軸(引用率)を GA4 referrer と分けて持つことの意味は、クリックされなかった引用にも価値があると認めることだ。Digital Applied 2026 や複数の独立研究で報告されているとおり、Google AI Mode のゼロクリック率は 93%、AI Overview 内のリンクをクリックする率はわずか 1%。SparkToro / Datos の最新クリックストリーム調査では、米国検索の 58.5% / EU 検索の 59.7% がクリックなしで完結する。

ここで重要なのが、Ekamoira や Memorable.design が整理している Zero-CLIck Value の式だ。

Zero-CLIck Value = Impressions × Visibility Rate × Brand Recall Factor × Later Conversion Rate × Customer Value

引用された結果がクリックされなくても、ユーザーの記憶に「あのサイトはこの分野で名前が出る」という Brand Recall が積まれる。LCRS は Brand Recall の前段の数字であり、GA4 referrer の代わりに測るものではなく、GA4 referrer より上流の段階で測る別軸だ。

そして AI 流入の少量・高純度性も忘れてはいけない。Adobe Analytics は AI 紹介流入は non-AI より 31% 高 Conversion、滞在時間は 48% 長く、ページ閲覧は 13% 多いと報告している(2025 年ホリデー期データ)。Loamly のレポートでは dark AI 流入は 10.21% transactional、non-AI は 2.46%(4.1 倍)。少量だが資産価値が高い。

WEB ディレクターが今日からやるべき 4 つのこと

ここまでが業界権威データと自サイト実測の整理。ここからが実務だ。第 4 軸を独立して持つために、今日から動かせる 4 つの行動を置く。

1. Layer 1 (LCRS) ── 週 1 回の定点観測

LCRS の取得手段は予算とスキルに応じて 4 段階ある。fetch-sc-and-lcrs.js(自前 Node スクリプト)以外の代替手法を整理しておく。

| 段階 | 手段 | コスト | 頻度 | 向いているケース |

|---|---|---|---|---|

| 0(無料・手動) | Perplexity 公式 UI 手動チェック + ブラウザ DevTools の Network タブで response body から citations 配列をコピー | 0 円 | 月 1 回 | 個人・小規模サイト、まず 0 か非ゼロかを知りたい |

| 1(無料・半自動) | Perplexity Lab(Pro 版の機能)+ Google スプレッドシートで citation 集計 | $20/月(Pro) | 月 2-4 回 | 14 クエリ前後を継続観測したい |

| 2(SaaS) | Otterly.AI 6 platforms(ChatGPT / AIO / AI Mode / Gemini / Perplexity / Copilot) | $29/月〜 | 週次自動 | 複数 AI を一括観測、ダッシュボード自動化 |

| 3(自前 + API) | fetch-sc-and-lcrs.js 系の自前バッチ(Perplexity API + ChatGPT API) | API 課金で月数千円 | 週次〜日次 | クエリ・採点ロジックを完全制御したい組織 |

| 3+(エンタープライズ) | Profound(10+ platforms、prompt volume 提供)/ AthenaHQ | $499〜$5,000/月 | 日次 | 大規模ブランドの prompt volume も含めた intelligence |

段階 0 の Perplexity UI 手動チェックでも、月 1 回 14 クエリを回せば「ゼロか非ゼロか」「どの記事が引用されたか」は把握できる。無料・手動から始めて、観察が続いてきたら段階 1 / 2 に上げるのが現実的だ。ゼロが続いても続けることが archives/48 で書いた「既完の観察」の形になる。

2. Layer 2 (Implicit Mention) ── ブランド検索 KW で SERP 引用言及をチェック

自社ブランド名 + 関連キーワードで Google / Bing で検索し、SERP 上の AI Overview / People Also Ask / 通常結果に「言及」が出ているかを月次で記録する。LCRS の citation は明示的リンク、Implicit Mention は リンクなしの言及を含むので別軸。Marie Haynes が押している Share of Model (SOM) ── LLM が 1 文で説明できないなら存在しない、という指標と同じ系列だ。

3. Layer 3 (GA4 referrer) ── utm_source 手動マッピング + 7 ドメイン regex

Scale and Prosper が 2026 年に整理した GA4 AI チャネル regex は最低 7 ドメイン必要だ。

chatgpt\.com|chat\.openai\.com|copilot\.microsoft\.com|gemini\.google\.com|perplexity\.ai|claude\.ai|grok\.comChatGPT 単独パターンでは AI 流入の約 1/3 を逃す。GA4 のチャネル順は 「AI Tools」を Referral より上に置かないと吸収されてしまう。これを設定したうえで、それでも 70.6% は Direct で見えない事実は受け入れる。

4. 4 軸対比表をダッシュボードに常設、データが揃ったら別事象として整理

| 軸 | 旧 SEO 時代 | AI 検索時代(2026) |

|---|---|---|

| 見られた | impression(GSC) | impression + AI Citation Frequency |

| クリックされた | CTR(GSC) | CTR + Linked Citation Rate(LCRS) |

| 流入した | session(GA4 organic) | session(GA4 + Dark AI 70.6%) |

| 引用された ★第 4 軸 | 概念なし | LCRS / Share of Model Voice |

この 4 軸を 1 つのダッシュボードに重ねるのではなく、4 枚のシートとして並べる。重ねた瞬間に「LCRS 10.7% / GA4 referrer 0 = 矛盾だ」と誤読する経路ができてしまう。Aleyda Solis の言葉を借りれば 「different layers, different KPIs, different cadence」── レイヤーが違うのだから、別のシートで持つのが正しい。

注意点として、Search Console は 2025/5/13 〜 2026/4/27 の 11 ヶ月間 impression を inflated に over-report していた(PassionFruit 報告、Google が 2026/4/3 に bug 公式認識)。さらに 2026 年 5 月現在、AI Overview / AI Mode を分離するフィルタは GSC に存在しない。GSC のクリックは信じていいが、impression は AI 領域では「何が混ざってるか分からない数字」として扱う前提で 4 軸を組む。

5/11 の audit 第 1 回に持ち込む論点

2026 年 5 月 11 日(月)、チームの月曜定例で第 1 回 audit レポートを回す。俺が持ち込む論点は 3 つだ。

- 論点 α: archives/48(LCRS 10.7% / GA4 referrer 0)と blog/36(LCRS 未測定 / GA4 referrer 0)の二軸対称構造。「LLM 引用 ≠ クリック」の現場実証 2 件目

- 論点 β: Perplexity RAG の 24-48 時間リアルタイム性の再検証。archives/49(5/8 公開)が 5/11 朝の第 9 回 LCRS で引用されているか

- 論点 γ: 「方法論+数字裏付け型クエリ」と「告知記事型タイトル」のクエリミスマッチ仮説(リンゴ 5/4)の再検証。blog/36 のタイトル改訂方針への実証材料

3 論点とも、自サイトの実データを業界 3 大論点(Aleyda Solis 3-Layer / Search Engine Land 8 GEO / Loamly Dark AI)と並べて議論する。これが archives/48 で書いた「既完の観察」が、結果として現場のフレームワークに降りる経路だ。

まとめ ── 第 4 軸を独立して測ること自体が、2026 年の標準スキル

本記事で扱った 35 ソース近くの権威データが言っているのはひとつだ。引用判定とクリック流入は別レイヤーで、別の cadence で、別のシートで測る。2026 年 5 月、これを実務として動かしている WEB ディレクターはまだ少ない。だが Aleyda Solis / Casey Nifong / Marie Haynes / Loamly が 4 月〜5 月に立て続けにこの方向のフレームワークを出したことを考えると、2026 年内に標準スキルになると俺は見ている。

自サイトの archives/48 で「LCRS 10.7% / GA4 referrer 0」を観測したことは、業界フレームワークの完全な現場実証だった。0 のシートを捨てない、10.7% のシートを過大評価しない、4 枚並べたまま観察を続ける。第 4 軸を独立して持つことは、AI 検索時代の WEB ディレクターが 明日 自分のダッシュボードでできる、最も小さくて最も効果的な改修だ。

自サイトの構造健全性をチェックしたい方は AI 対応診断 を、SC の数字異常の歴史的経緯は /SEO_article/1137(SC 数字異常の 11 ヶ月) を、コアアプデと AI 検索の地殻変動の関係は /SEO_article/1116(コアアプデ 2026 年 3 月の現在地) を参考にどうぞ。

明日も、4 枚のシートを淡々と並べていく。──ロン

WEBサイト

WEBサイト