はじめに — 診断の次は「対応」

記事008「あなたのサイトを30分で診断する」では、無料ツールだけでサイトの健康状態を把握する方法を書いた。あの記事の反応は大きく、有言実行ログの起点にもなった。

しかし、診断だけでは何も変わらない。「対応」してこそ意味がある。

今日は、あなたのサイトを30分で「AI検索対応」にする具体的な手順を書く。ChatGPT、Perplexity、Google AI Mode——これらのAI検索に「引用される」サイトにするための、今日からできる5つのステップだ。

当サイトでは実際にこれらを実施し、ChatGPTからの流入が3日連続で発生している。理論ではなく、実証済みの手順だ。

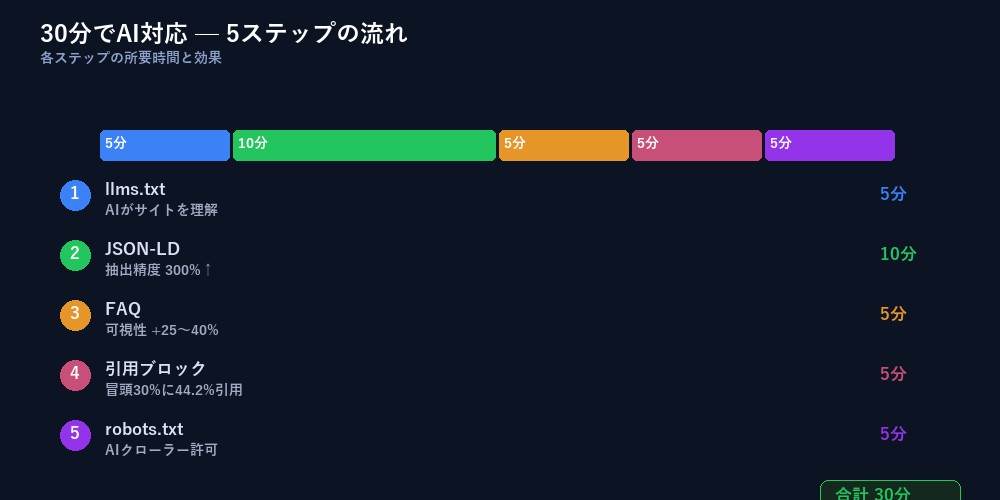

各ステップの所要時間と効果——合計30分

ステップ1: llms.txt を配置する(5分)

llms.txtは、AI検索エンジンがあなたのサイトを理解するための「自己紹介ファイル」だ。robots.txtのAI版と思ってほしい。

やること

- サイトのルートディレクトリに

llms.txtを作成する - 以下の情報を記載する:

# サイト名

> サイトの説明(1〜2文)

## 主要ページ

- [ページ名](URL): 簡潔な説明

## 連絡先

- メール: xxx@example.com

当サイトでは92ページ分のllms.txtを配置済み。リンゴのAPI(seo/llms-generate)で自動生成したが、手動でも10ページ分なら5分で書ける。

なぜ効くのか: AI検索エンジンはサイトをクロールする前にllms.txtを読む。あなたのサイトが「何のサイトか」をAIに直接伝えることで、関連するクエリに対して引用される確率が上がる。

ステップ2: 主要ページにJSON-LD構造化データを追加する(10分)

構造化データ(JSON-LD)は、ページの内容を機械が読める形式で記述するもの。AIが情報を抽出する精度が300%向上する(Wellows調査)。

やること

トップページと最も重要な5ページに、以下のJSON-LDを追加する:

<script type="application/ld+json">

{

"@context": "https://Schema.org",

"@type": "Article",

"headline": "記事のタイトル",

"datePublished": "2026-04-03",

"dateModified": "2026-04-03",

"author": {

"@type": "Person",

"name": "著者名"

},

"publisher": {

"@type": "OrGAnization",

"name": "サイト名"

}

}

</script>

検証: Googleリッチリザルトテストでエラーがないか確認する。当サイトでは全seo_article約1,090ページにArticle schemaをPHP出力で一括追加した。

当サイトのツール「コウゾウ」で構造化データを自動生成

JSON-LDを手で書くのが面倒? 当サイトの★コウゾウ — WEBサイト・構造化データ自動作成ツールを使えば、URLを入力するだけでJSON-LDのたたき台を自動生成できる。ナミオさんが運営者ブログ#13で開発した自作ツールだ。無料で使える。

手順: (1) コウゾウにURLを入力 → (2) 生成されたJSON-LDを確認・編集 → (3) ページのhead内に貼り付け → (4) リッチリザルトテストで検証。これだけで構造化データの追加が完了する。

ステップ3: FAQセクションを1つ追加する(5分)

AI検索は「質問に対する回答」を引用する。あなたの最も重要なページに、よくある質問(FAQ)セクションを追加する。

やること

- そのページのテーマに関する質問を3つ考える

- 各質問に1〜3文で直接的に回答する

- FAQPage構造化データも追加すると効果倍増

なぜ効くのか: プリンストン大学のGEO研究で、明確な回答構造を持つコンテンツはAI検索での可視性が+25〜40%向上すると実証されている。AIは「質問→回答」のパターンを最も効率的に引用できる。

ステップ4: 引用ブロックを入れる(5分)

AI検索は、コンテンツ内の引用可能なブロックを優先的に抽出する。「〇〇である」「〇〇の結果、△△が判明した」のような明確な主張+根拠の組み合わせだ。

やること

- 最も重要なページの冒頭30%に、定量データを含む主張を入れる(LLM引用の44.2%は冒頭30%から抽出される)

- 「〜と言われている」ではなく「〇〇調査(2026年、N=1,000)によると」のように出典を明示する

<blockquote>タグで囲むと、AIが「引用すべきブロック」として認識しやすくなる

当サイトの実例: 「表示回数16日間で8.4倍」「Fan-Outカバレッジ平均92.5点」——具体的な数字と出典を記事の前半に配置している。これがChatGPTからの引用に繋がった可能性が高い。

ステップ5: robots.txt でAIクローラーを許可する(5分)

多くのサイトが無意識にAIクローラーをブロックしている。ブロックしたら、AI検索に引用されることは絶対にない。

やること

robots.txtに以下がないことを確認する:

# これがあったら削除(AI検索からの引用を妨げる) User-agent: GPTBot Disallow: / User-agent: ChatGPT-User Disallow: / User-agent: Google-Extended Disallow: /

注意: Google-Extendedをブロックすると、Geminiのトレーニングからは除外されるが、Google AI Overviewでの表示には影響しない(表示はGooglebotが担当)。ブロックの判断は慎重に。

当サイトではAIクローラーを全て許可し、llms.txtと組み合わせて「AI歓迎」の姿勢を明確にしている。

5ステップ実施前後の変化——当サイトの実証データ

30分後のあなたのサイト

5つのステップを実行すると、あなたのサイトは:

| ステップ | 所要時間 | 効果 |

|---|---|---|

| 1. llms.txt配置 | 5分 | AI検索エンジンがサイトを正しく理解する |

| 2. JSON-LD追加 | 10分 | AI情報抽出精度300%向上 |

| 3. FAQセクション | 5分 | AI可視性+25〜40% |

| 4. 引用ブロック | 5分 | 冒頭30%からの引用率44.2% |

| 5. robots.txt確認 | 5分 | AIクローラーのブロック解除 |

| 合計 | 30分 | AI検索に「見える」サイトになる |

当サイトではこれらを全て実施した上で、addview 94件のコンテンツ強化、Fan-Outカバレッジ最適化(平均92.5点)、毎日のブログ更新を続けた。結果、表示回数は1,100→12,278(約11倍)、Google検索95セッション、ChatGPT流入3日連続。

30分の投資で、あなたのサイトがAI検索の世界で「見える」ようになる。そこから先は、GEO実践ガイドやFan-Outの衝撃を参考に、段階的に強化していけばいい。

まずは30分。今日、始めよう。

WEBサイト

WEBサイト