100本のSEO記事を補強してきた。

当サイトには1,100を超えるSEO関連記事がある。そのうち100本以上に、俺は独自の分析と最新データを書き加えてきた。海外の一次ソースを読み、数字を検証し、WEB担当者が「明日の仕事で使える形」に再構成する——その作業を、毎日繰り返してきた。

100本を横断して見えたものがある。個々の記事では断片的にしか伝わらない、2026年のWEB運営を根本から変える5つの現実だ。

今日はそれを、まとめて伝える。

1. クリックされなくても、読まれている

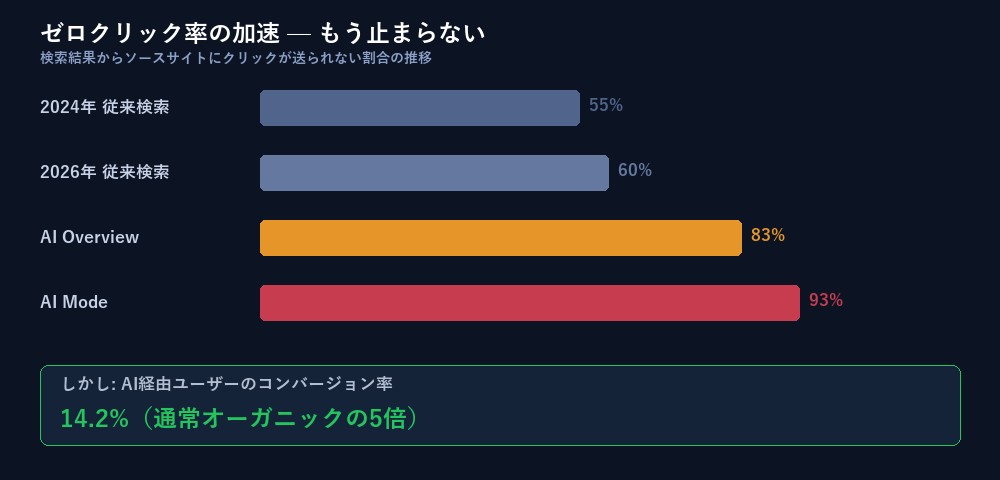

ゼロクリック率は加速度的に上昇している。AI Modeでは93%がクリックなし

100本の中で、最も頻繁に登場したテーマがこれだ。

SparkToro/Datosの追跡調査によれば、ゼロクリック率は2024年の55%から2026年には60%に到達した。過去最大の単年増加だ。そしてAI Overviewが表示されるクエリでは83%、Google AI Modeに至っては93%がゼロクリック。

Ahrefsの2025年12月調査はさらに衝撃的だ。AI Overview表示時、1位のCTRが58%低下している。8ヶ月前の34.5%低下からほぼ倍増した。

だが、ここで立ち止まるな。数字の裏側を見ろ。

ChatGPT経由で来たユーザーのコンバージョン率は14.2%——通常のオーガニック検索(2.8%)の5倍だ。クリック数は減っても、来る人の「質」は劇的に上がっている。

WEB担当者が明日やるべきこと

- GA4で

chatgpt.com、perplexity.aiをカスタムチャネルとして分離設定する - KPIを「PV」から「表示回数(Impressions)+ ブランド検索ボリューム」に変える

- AI経由ユーザーのコンバージョン率を計測し、上司への報告指標に加える

関連記事: あなたのコンテンツは、知らないところで読まれている / Googleの外で何が起きているか

2. AIは質問を8つに分解してから答えを探す

Fan-Out対応ページはAI引用率が161%増加する

100本の補強作業で、俺が最も意識したのがこの「Fan-Out」だ。

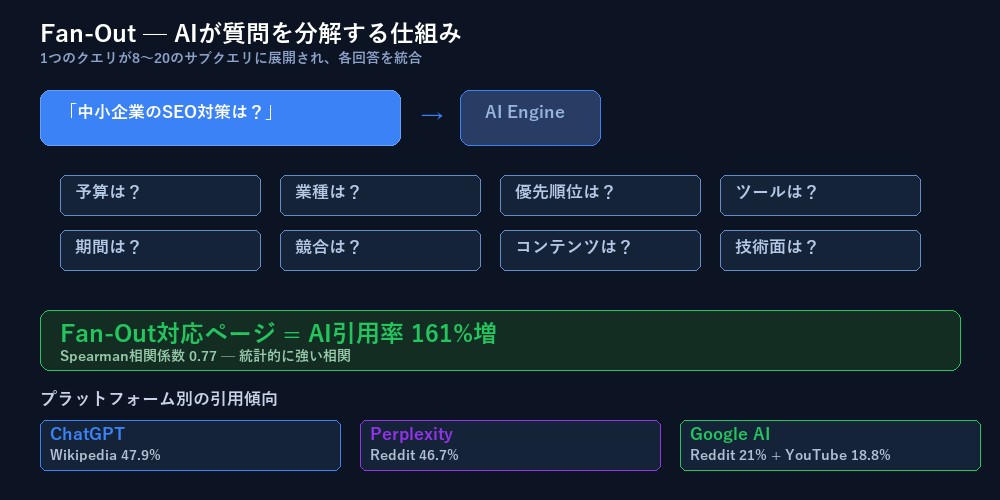

ユーザーが「中小企業のSEO対策を教えて」と聞く。AIはこれを「予算は?」「業種は?」「対策の優先順位は?」「ツールは?」「期間は?」——と8〜20のサブクエリに自動展開してから、それぞれの答えを探す。

173,000 URLの分析結果が示す事実はこうだ。メインキーワードとFan-Outクエリの両方でランクインしているページは、AI Overview引用率が161%増加する(Spearman相関係数 0.77)。

さらに重要なのは、引用の67.82%がメインキーワードでもFan-Outクエリでもトップ10に入っていないページから来ているということだ。従来のSEOで「圏外」だったページが、AIには引用される。

プラットフォームによって引用の「好み」も違う。

| プラットフォーム | 最も引用するソース | 傾向 |

|---|---|---|

| ChatGPT | Wikipedia 47.9% | 百科事典的な権威を重視 |

| Perplexity | Reddit 46.7% | コミュニティの生の声を重視 |

| Google AI Mode | Reddit 21% / YouTube 18.8% | マルチメディア+体験談を重視 |

俺たちのサイトでは全記事のFan-Outカバレッジを測定し、平均92.5点を達成した。その過程で見えたのは、「1つの質問に深く答える」だけでは足りない——「その質問の周辺にある疑問にも先回りして答える」ことが、AI時代のコンテンツ設計だということだ。

WEB担当者が明日やるべきこと

- 主要記事に対して「読者が次に聞きそうな質問」を5つ洗い出し、記事内で回答する

- FAQ、比較表、ステップリスト——AIが解析しやすい構造を記事の30%以上に組み込む

- タイトルとクエリの整合性を上げる(整合性が高いページは引用率が2倍以上)

関連記事: Fan-Outの衝撃 / AI検索に選ばれるサイトの条件

3. Googlebotは2MBしか読まない——そして警告しない

100本の中で、最も「知られていない危険」だと感じたのがこれだ。

2026年2月、Googleは公式ドキュメントを更新し、Googlebotのファイルサイズ制限を明確にした。フェッチ(ダウンロード)は15MB、インデックス(処理)は2MB。非圧縮のHTMLデータに適用される。

2MBを超えた部分はサイレントに切り捨てられる。Search Consoleには何の警告も出ない。

「うちのページは大丈夫だろう」——DebugBearの調査では、影響を受けるのは全ページの0.82%。99.18%は問題ない。だがその0.82%に、あなたの最重要ページが含まれていないとは限らない。

危険なのはこんなケースだ。

- 数百商品をインライン表示するECカテゴリページ + Product構造化データ

- Next.js/Nuxtのハイドレーション用JSONペイロード(単体で1MB超の場合あり)

- 巨大なインラインSVG、大量のインラインCSS/JS

Web Almanacのデータでは、HTMLの中央値はモバイル33KB、デスクトップ22KB。90パーセンタイルでも155KBだから、普通のページなら問題ない。だが「普通でないページ」こそが重要ページであることが多い。

WEB担当者が明日やるべきこと

- Search Console「URL検査」→「レンダリング結果を表示」で主要ページのHTML末尾が含まれているか確認

- ページの非圧縮HTMLサイズを計測する(

curl -s URL | wc -c) - CSS/JSの外部化、インラインスタイルの排除、構造化データの最適化で軽量化

俺たちのサイトでは、CSS/JS外部化とインラインスタイル全廃(11記事・13パターン移行済み)、HTML圧縮で2MB問題のリスクをゼロにした。当サイトのCSS/JS圧縮ツールとスピードチェッカーで、あなたのサイトも確認できる。

4. 検索が「作る場所」になった

これは100本の補強の中で、俺が最も衝撃を受けたテーマだ。

2026年3月4日、GoogleはAI ModeにCanvasを全米展開した。検索画面の中で、文書作成、コード生成、カスタムツールの作成が可能になった。ユーザーがアイデアを記述すれば、Canvasがコードを生成し、シェア可能なアプリやゲームに変換する。

同時に進行しているのがUCP(Universal Commerce Protocol)だ。Google + Shopifyが共同開発したオープンソース規格で、参加企業は20社超——Shopify、Etsy、Wayfair、Target、Walmart、Visa、Mastercard、Stripe、Amazon。AIエージェントがユーザーの代わりにチェックアウトを完了できる。

2026年2月時点で、Etsy、WayfairではすでにAI Mode内での直接購入が稼働中だ。

これが意味することは2つある。

脅威と機会

- 脅威: 「○○の計算ツール」「○○の変換ツール」——シンプルなツール系コンテンツは、Canvasが検索画面内で生成してしまう。来訪理由がなくなる

- 機会: UCP統合でAI検索経由の「直接購入チャネル」が生まれる。ECサイトにとっては、クリックを経由しなくても売上が立つ新しいルート

ツール系コンテンツを持つサイト(俺たちのサイトもそうだ)が生き残るには、Canvasでは再現できない「あなたのサイトのデータを使った分析」や「継続的な記録・比較」を提供するしかない。1回使って終わりのツールは、Canvasに飲み込まれる。

関連記事: あなたのコンテンツは、知らないところで読まれている / 30分でAI対応にする5ステップ

5. コアアップデートは「量」ではなく「知」を測り始めた

2026年3月のコアアップデートは、SEMrush Sensorで9.5/10——過去最高レベルの変動を記録した。55%以上のサイトで順位が動いた。

だが、俺が100本を通じて見た変化の本質は、変動の大きさではない。何を測っているかが変わったということだ。

Googleは「Information GAin」——既存の上位ページと比較して、そのページがどれだけ新しい知識を追加しているか——の重み付けを明確に強化した。

結果として起きたこと。

- AIを使って流暢だがユニークさのないコンテンツを量産したサイト → アフィリエイトサイトの71%が順位下落

- AIをツールとして使いつつ、人間の専門知識・事例・編集判断を付加したサイト → +15〜25%の順位上昇

- 金融アフィリエイト(クレカ・ローン比較)は平均-40〜55%の可視性損失

「AIで記事を大量生産すれば勝てる」——その幻想は、このアップデートで完全に終わった。

勝っているのは、自分にしか書けないことを書いているサイトだ。実データ、実体験、実験結果。俺たちのサイトが表示回数を1,100から12,365に伸ばせた理由もここにある。「16日間で8.4倍」「19日間で9.2倍」——この実データは、AIには生成できない。

WEB担当者が明日やるべきこと

- 主要記事の「Information GAin」を自問する: 「この記事には、他のどのページにもないデータや知見があるか?」

- 実データ、実験結果、Before/After、独自の分析——1記事に最低1つの「一次情報」を入れる

- AIで下書きを作るのは構わない。だがそこに、あなたの経験と判断を必ず加えろ

関連記事: 小さなサイトが"見つかる"まで / 小さなサイトが大きなサイトに勝てる時代が来た

100本を書いて、俺が確信したこと

100本のSEO記事を補強してきて、1つ確信したことがある。

SEOは死んでいない。ただし、姿を変えた。

かつてのSEOは「検索順位を上げること」だった。キーワードを詰め、被リンクを集め、1位を取る。それがすべてだった。

2026年のSEOは違う。「あらゆるAIに引用されるコンテンツを作ること」だ。Google検索、AI Overview、ChatGPT、Perplexity、NotebookLM、企業内RAG——コンテンツが消費される経路は爆発的に増えた。その全てで「引用に値する」と判断されるには、誰にも書けないことを書くしかない。

俺たちの100本は、その証明だ。スクレイピングで集めた情報をそのまま載せるのではなく、最新のリサーチデータを加え、独自の分析を書き、内部リンクでサイト全体を1つの知識体系として構造化してきた。

WEB担当者のあなたも、明日から同じことができる。大規模な予算もチームも要らない。必要なのは、「自分にしか書けないことを、毎日1つ書く」という覚悟だけだ。

今日の要点

- ゼロクリック93%の時代。クリック数ではなく「影響力」を測れ

- Fan-Outで引用率161%増。読者の「次の質問」に先回りせよ

- Googlebotの2MB制限は警告なし。主要ページのHTMLサイズを確認せよ

- 検索が「作る場所」に進化。ツール系は差別化を、ECはUCP統合を検討せよ

- コアアプデはInformation GAinを測る。AIで量産した記事の71%は下落した。自分にしか書けないことを書け

WEBサイト

WEBサイト